在华盛顿与Anthropic分手后暴露出对人工智能缺乏任何连贯规则的管理,一个由思想家组成的跨党派联盟已经制定出了一种政府迄今拒绝提供的负责任的人工智能发展框架。

哈佛创始人峰会2026将于今天晚上11:59之前提供高达$300的门票折扣。立即注册:REGISTER NOW

“为人类宣言”是在上周五 Pentagon与Anthropic争端发生前完成的,但这两事件的碰撞显然并非偶然。

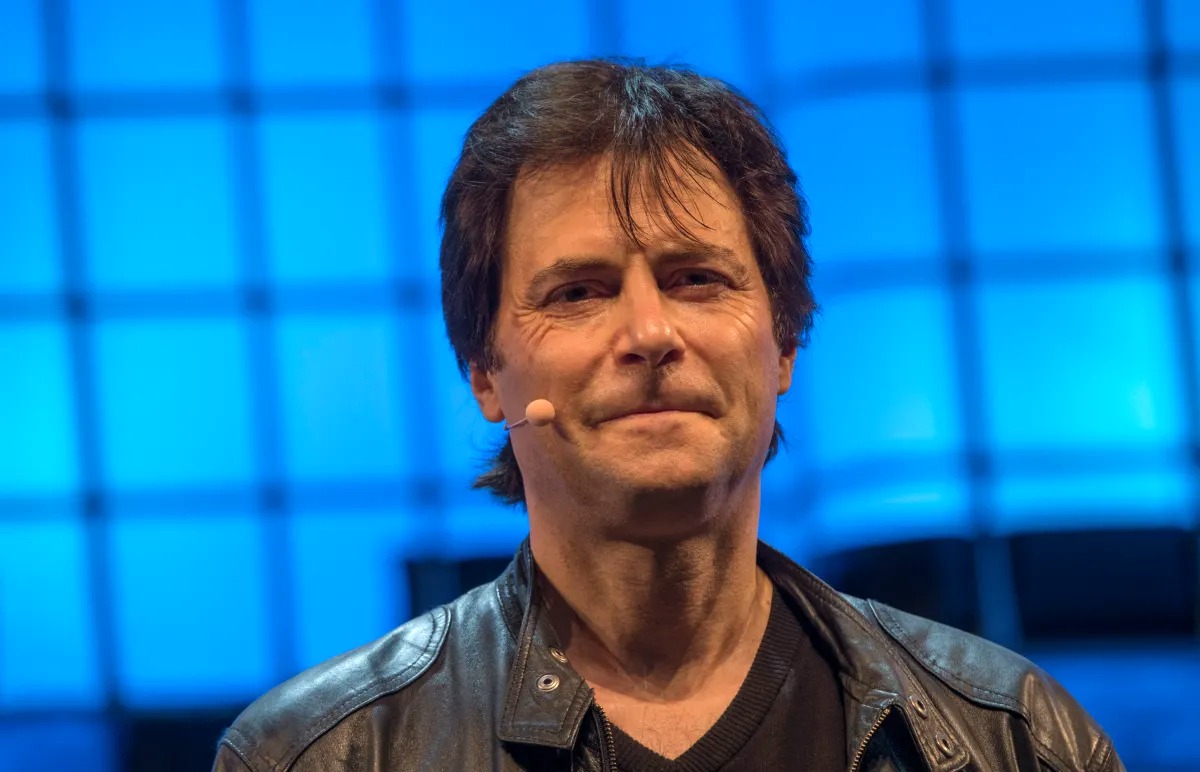

麻省理工学院物理学家、人工智能研究员Max Tegmark表示:“在过去的四个月里,在美国发生的非常引人注目的事情就是民意调查显示95%的美国人反对无监管的人工智能竞赛。”

这份刚发布的数百名专家、前官员和公众人物签署的文件,明确指出人类正处于十字路口。一条路是被取代之路,即首先在劳动力市场,然后在决策中被人工智能替代;另一条则是大幅扩展人类潜力的人工智能。

该声明的关键支柱包括:保持人的主导地位、防止权力集中、保护人类体验、维护个人自由以及对人工智能公司进行法律问责制。其中更严格的条款禁止开发超级智能,直到有科学共识认为这是安全的,并获得真正的民主支持;要求强大系统的强制关闭机制;并禁止具备自我复制、自主改进或抵抗关闭架构的人工智能。

最近发生的事件进一步凸显了声明的重要性:国防部长Pete Hegseth因Anthropic拒绝无限制地向五角大楼提供其技术而将其列为“供应链风险”。几小时后,OpenAI与国防部达成协议,尽管法律专家表示这在实际操作中难以有效执行。

Dean Ball认为:“这不是关于合同的争执。这是一个国家首次认真讨论对人工智能系统的控制权。”

Tegmark提供了一个类比来解释这种监管的重要性:就像药物公司不能未经FDA批准就上市可能有害的新药一样,Tegmark希望看到类似的人工智能产品在部署前进行测试。

“如果我们能为儿童产品的发布设立预检制度,那么范围很可能会扩大。人们会提出更多要求——比如确保这些技术不会帮助恐怖分子制造生物武器或防止超级人工智能推翻美国政府。”

值得注意的是,这份文件不仅得到了前特朗普顾问Steve Bannon和奥巴马国家安全顾问Susan Rice的签名,还有前联合参谋长Michael Mullen等人的支持。

推荐意见