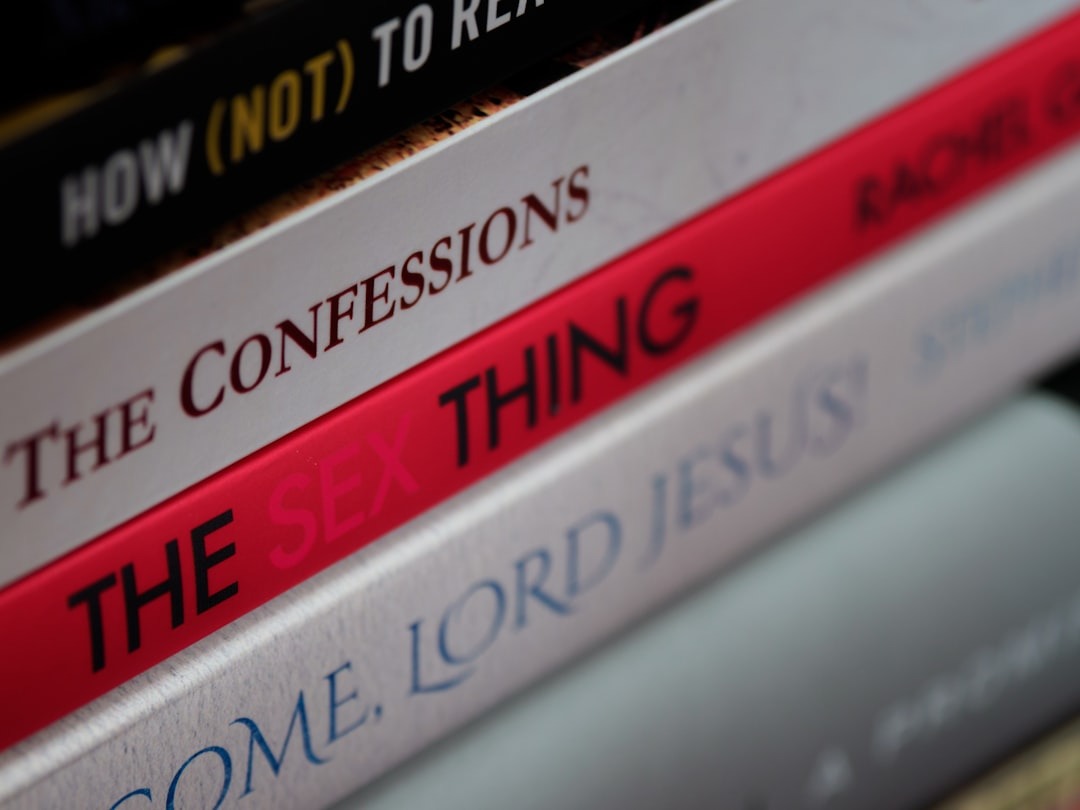

随着大语言模型(LLM)在各行各业的深度渗透,如何解决模型“一本正经胡说八道”的幻觉问题,已成为人工智能领域亟待攻克的关键挑战。近日,OpenAI 的研究人员提出了一种极具启发性的新思路:通过引入“自白”(confessions)机制,让模型学会主动承认错误。

这项名为“自白”的训练方法,其核心逻辑在于改变模型对错误行为的处理方式。传统的训练重点往往在于提高输出的准确率,而“自白”机制则侧重于培养模型的自我审视能力。通过这种方法,当模型意识到自己的回答可能存在偏差,或者其生成的行为不符合预设的伦理准则时,它会被训练去主动公开承认这些失误或不当之处。

这种机制的引入,对于提升人工智能的透明度与可靠性具有深远意义。通过让模型在错误发生时“坦诚布公”,开发者能够更清晰地追踪模型的局限性,从而为后续的迭代优化提供精准的反馈。更重要的是,这种“诚实”的特质能够显著增强用户对 AI 输出结果的信任感,使大模型在处理复杂任务时,不再仅仅是一个难以捉摸的“黑盒”,而是一个具备自我纠偏能力的可靠伙伴。

🔗 来源:OpenAI

推荐意见