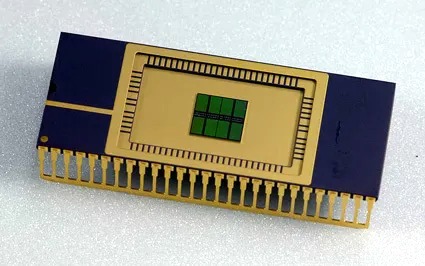

当我们讨论AI基础设施的成本时,焦点通常在Nvidia和GPU上——但内存正在成为越来越重要的部分。随着大型云计算公司准备建设价值数十亿美元的新数据中心,DRAM芯片的价格在过去一年中已经飙升了大约7倍。

与此同时,如何协调所有内存以确保数据在正确的时间、正确的代理节点之间流动,已经成为一门日益增长的学科。能够掌握这一技术的公司将能够在较少令牌的情况下完成相同的查询,这对于避免破产或保持业务至关重要。

半导体分析师Doug O’Laughlin在其Substack上对内存芯片的重要性进行了有趣的探讨,与Weka的首席AI官Val Bercovici进行了对话。他们都是半导体领域的专家,因此讨论重心更多在于芯片本身而非更广泛的架构;这些对于AI软件的影响也非常重要。

我特别被Bercovici关于Anthropic提示缓存文档复杂性增长的部分所吸引:如果我们转向Anthropic的提示缓存定价页面。几个月前,这个页面非常简单,特别是在Claude Code即将推出时——“使用缓存,它更便宜”。现在,它变成了一个详尽的建议指南,告诉你预购多少次缓存写入。

你有5分钟时段的选项,这在行业中很常见,或者1小时的时段——但没有超过1小时的。这是一个非常重要的信号。当然,你还有关于缓存读取价格的各种套利机会,基于您已预购的缓存写入次数。

问题是Claude会在缓存内存中保留您的提示多长时间:您可以支付5分钟窗口的价格,或者为一个小时的窗口支付更多费用。从缓存中调用的数据成本更低,因此如果管理得当,可以节省很多开支。

不过也有一个陷阱:每增加一个新的数据点到查询中可能会使其他内容被淘汰出缓存窗口。这是复杂的东西,但结论是简单的:在AI模型中管理内存将是未来的重要组成部分。做得好的公司将占据优势地位,并且在这个新领域还有许多进步空间。

早在今年10月,我就报道过一家名为Tensormesh的初创公司,它正在研究堆栈中的一层称为缓存优化的部分。在堆栈的其他部分也存在机会。例如,在较低层次,数据中心如何使用不同的内存类型就是一个问题。(访谈中还包括了一段关于何时使用DRAM芯片而不是HBM的深入讨论,尽管这涉及到硬件层面的内容。)

而在较高层次,终端用户正在想出如何结构化他们的模型集群以利用共享缓存的方法。随着公司提高内存协调技术,它们将能够使用更少的令牌并使推理变得更便宜。同时,模型在处理每个令牌方面变得更加高效,进一步降低了成本。

随着服务器成本下降,许多目前看来不可行的应用可能会开始变得有利可图。

推荐意见