近年来,人工智能技术的飞速发展推动了各种应用场景的创新与突破。其中,对比预训练(Contrastive Pre-training)作为一种新兴的预训练方法,在自然语言处理(NLP)和编程领域展现出巨大的潜力。

一、对比预训练概述

对比预训练是一种通过对比学习来提升模型泛化能力的方法。其核心思想是利用数据中的正样本和负样本之间的差异,让模型在训练过程中学会区分相似与不相似的数据对。

二、文本嵌入的应用

在自然语言处理领域,对比预训练能够生成高质量的文本嵌入。通过将文本转化为向量表示,可以更有效地捕捉语义信息和句法结构,进一步提升下游任务如文本分类、情感分析等的性能。

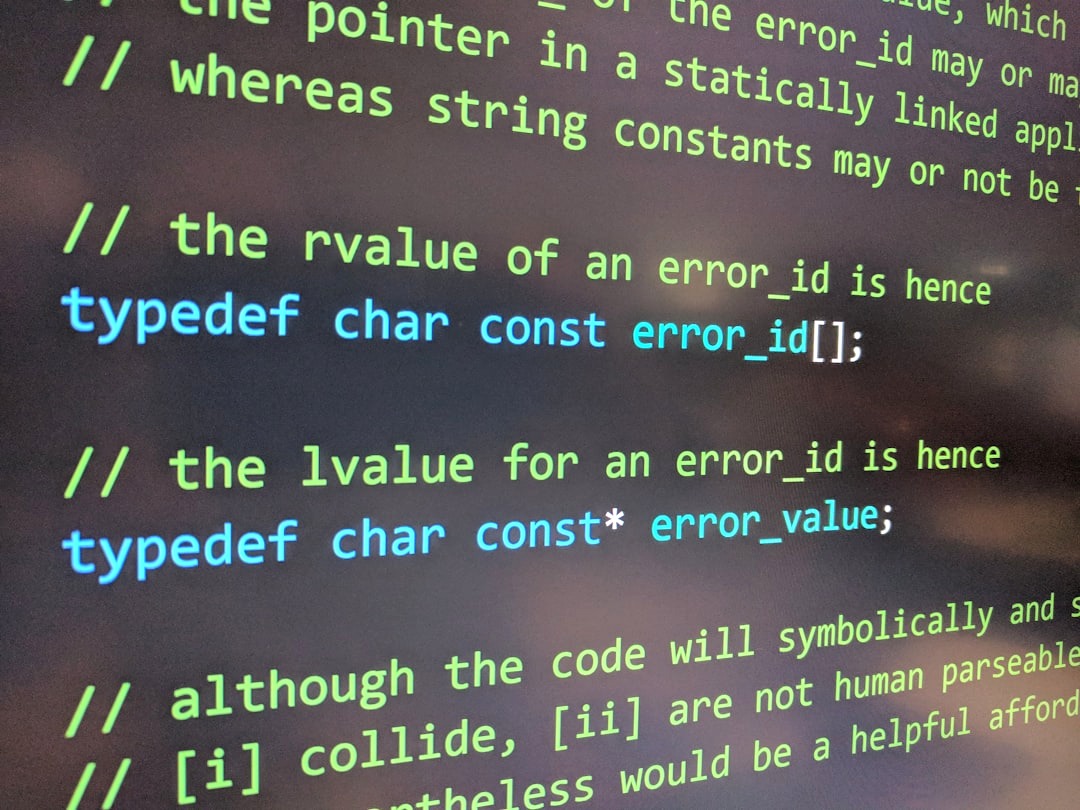

三、代码嵌入的应用

在编程领域,对比预训练同样发挥着重要作用。通过对代码片段进行嵌入处理,可以实现自动补全、错误检测等功能。相较于传统方法,这种方式能够更好地理解和利用代码的结构化特点。

四、技术优势与挑战

对比预训练具有几个显著的技术优势:首先,它能够在大规模数据集上快速学习到共性和差异;其次,这种方法对于缺乏标签的数据也相对友好。然而,在实际应用中仍面临一些挑战,如如何设计有效的正负样本对、怎样平衡模型的复杂度与泛化能力等。

五、未来展望

随着技术不断进步和应用场景日益丰富,对比预训练有望在更多领域发挥重要作用。未来的研究方向可能包括探索更加高效的学习机制、开发适用于特定任务的定制化模型等。

🔗 来源:Text and code embeddings by contrastive pre-training (AI 严选)

推荐意见