在人工智能领域,准确预测序列的后续走向——无论是文本、图像还是音频——始终是衡量生成式模型核心能力的标尺。近日,一种名为“稀疏Transformer”的新型深度神经网络架构问世,它在多项序列预测任务中刷新了性能纪录。

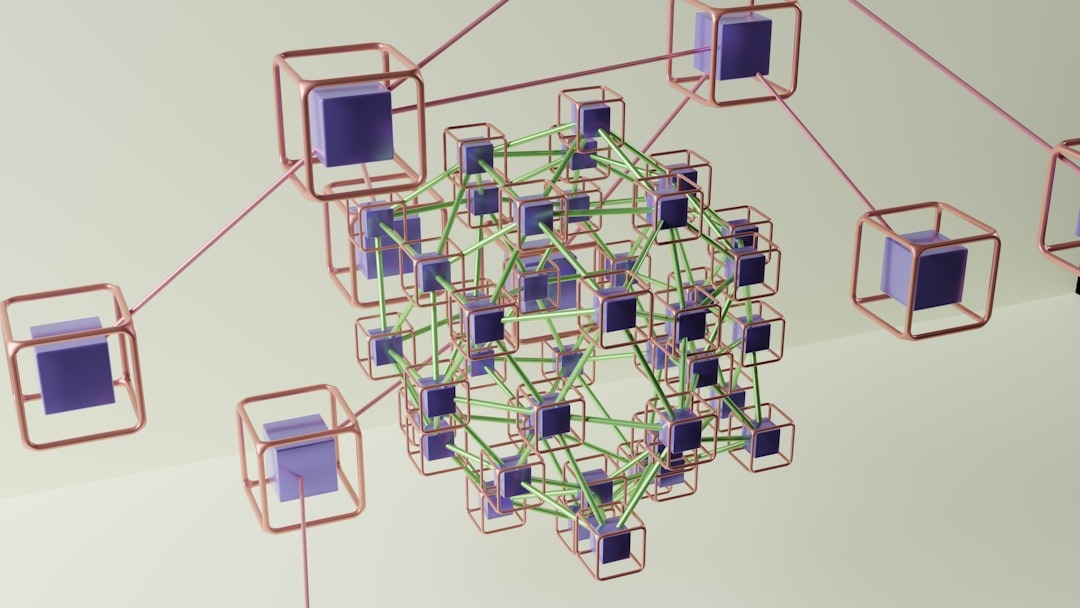

该技术的核心突破在于对传统注意力机制进行了深层的算法优化。通过引入稀疏化设计,稀疏Transformer成功解决了长序列计算复杂度激增的难题,使其能够从比以往长出30倍的超长序列中精准提取复杂的模式与特征。这一突破性进展不仅极大地扩展了模型处理超长上下文的能力,也为构建具备更强逻辑性与连贯性的下一代生成式人工智能奠定了关键的技术基石。

🔗 来源:OpenAI

推荐意见