在人工智能的演进史中,“开放”与“开源”从来不是同义词。长期以来,尽管 Google 的 Gemma 系列允许开发者下载并本地运行,但由于其特有的授权条款,开发者在分发与二次开发上始终面临着隐形的枷锁。这种状态更接近于一种“受限的开放”,而非真正意义上的“开源”。

然而,就在刚刚,Google 彻底打破了这一僵局。随着 Gemma 4 系列模型的发布,Google 正式宣布将该系列切换至 Apache 2.0 协议。这意味着,开发者现在可以自由地将模型用于商业、个人或企业用途,无需支付版税,且拥有修改与再分发的完全自主权。这不仅是一次技术更新,更是一场关于 AI 权利的回归。

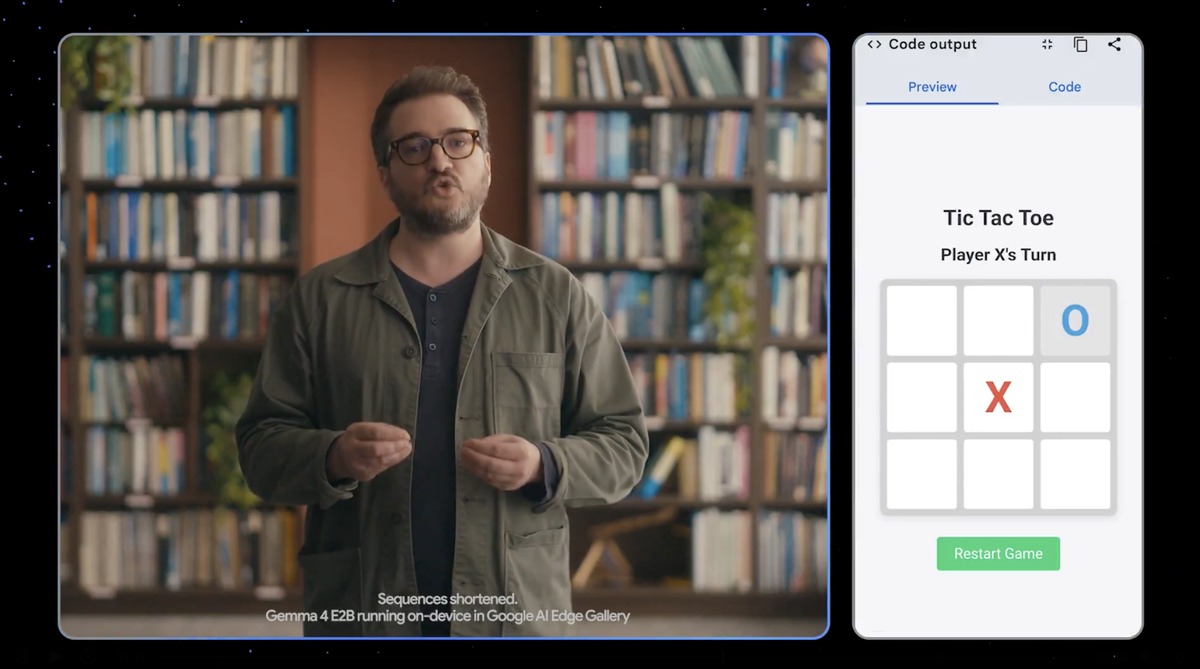

<长文本处理能力与多模态能力的进化,使得 Gemma 4 在边缘计算领域展现出了惊人的潜力。本次发布的四款模型涵盖了从超轻量级物联网设备到高性能工作站的完整频谱。其中,专为手机与物联网设备设计的 E2B 与 E4B 模型,通过仅激活 2B 和 4B 参数的精妙设计,实现了极低的内存占用与功耗。配合 128K 的上下文窗口以及原生支持的图像、视频与音频输入能力,这些模型甚至可以在树莓派或 Pixel 手机上实现完全离线的零延迟运行。在追求极致性能的维度上,Gemma 4 同样交出了令人震撼的答卷。采用混合专家架构(MoE)的 26B 模型,在推理时仅需激活 3.8B 参数,却在性能评估中展现出了足以媲美庞然大物的智能密度;而 31B Dense 模型则为本地微调提供了坚实的基座。基准测试的数据直观地展示了这种“以小博大”的跨越:在数学推理、代码编写以及智能体工具调用能力上,Gemma 4 相比前代实现了从百分之几十到接近百分之九十的跃升。

这种性能的飞跃,直接推动了 AI 应用场景的边界扩张。凭借强大的函数调用、JSON 结构化输出以及长达 256K 的上下文处理能力,开发者现在可以利用 Gemma 4 构建能够自主操作外部工具、理解复杂代码库的智能体(Agent)。这种能力不再局限于云端,而是可以被合法地打包进医疗、金融等对数据主权有严苛要求的行业硬件中,实现数据的本地化处理与安全闭环。

随着 NVIDIA 等硬件生态的深度适配,以及对 Hugging Face 等开发者社区的广泛支持,Gemma 4 正在构建一个前所未有的生态闭环。当强大的智能不再依赖于昂贵的云端算力,而是可以随身携带在每一台智能设备中时,我们正站在一场全新计算范式革命的边缘。

推荐意见