在当今快速发展的科技领域,尤其是人工智能(AI)研究中,一种名为“少样本学习”(Few-Shot Learning)的技术正逐渐崭露头角。这一技术的核心在于利用有限的数据或示例进行训练和学习,以适应新的任务或解决新问题。

语言模型作为这类技术的一个重要应用领域,它们能在几乎没有先验知识的情况下快速掌握并理解文本信息。这些模型通常通过大规模的预训练来获取广泛的知识,然后在特定任务上进行微调,即使面对完全未见过的数据也能给出合理预测或回答。

少样本学习的优势在于其灵活性和效率。相较于传统的机器学习方法,需要大量的标注数据才能实现较好的性能,少样本学习则要求更低的数据量,甚至只需几个示例就能完成学习任务。这对于资源有限的研究场景尤为重要,比如医疗诊断、法律咨询等专业领域,这些领域的数据集往往难以积累。

语言模型的这种能力已经在多个应用场景中得到了验证,例如对话系统能够根据少量用户输入迅速理解用户的意图并给出回复;在自然语言生成任务中,模型能够根据极少的提示自动生成高质量的文章或故事。这不仅提高了工作效率,也为创新提供了无限可能。

然而,少样本学习技术也面临着挑战,如如何确保模型的理解准确性和泛化能力,以及如何平衡效率与效果之间的关系等。未来的研究将致力于解决这些问题,进一步推动语言模型在各个领域的应用和发展。

🔗 来源:Language models are few-shot learners (AI 严选)

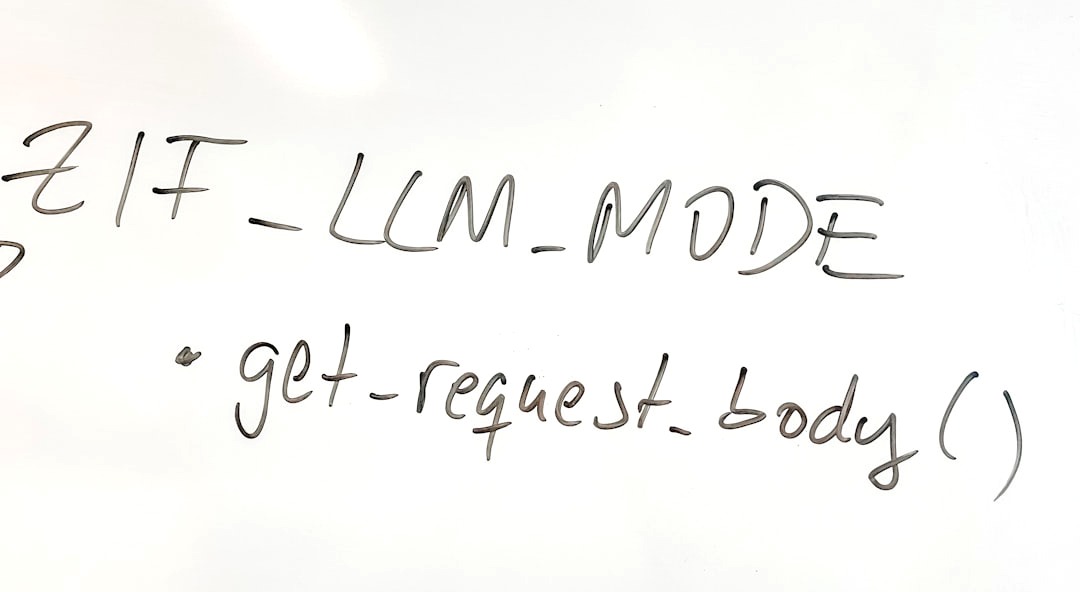

推荐意见