一项新的挑战在于理解深度学习模型的行为:无论是xAI在调校Grok时遇到的政治问题,还是ChatGPT面临的奉承难题,或是普通的大规模神经网络模型中的幻觉现象。这些复杂的现象使得研究人员难以追踪和解释。

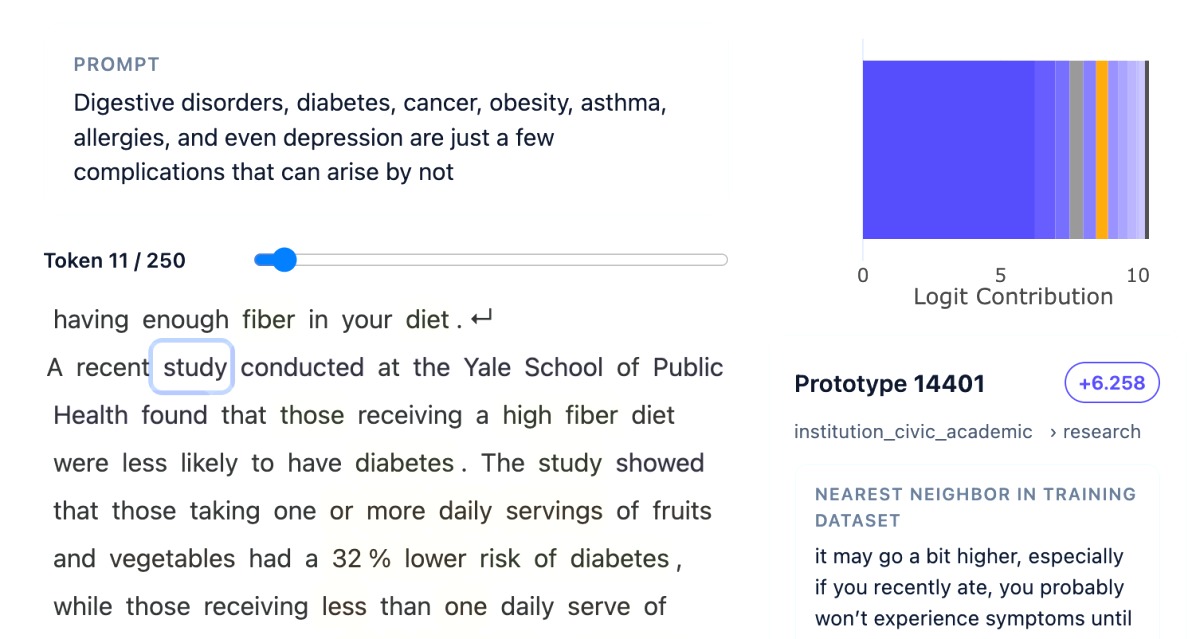

Guide Labs 是一家由 CEO Julius Adebayo 和首席科学官 Aya Abdelsalam Ismail 创立的旧金山初创公司,于本周一推出了一个80亿参数的可解释大型语言模型——Steerling-8B。这款模型具有独特的架构设计,能够追踪其生成的每个标记的来源:从事实引用的参考材料到复杂的概念理解,如幽默或性别差异。

Adebayo 向 TechCrunch 表示:“如果我有万亿种方式编码性别信息,并在其中一部分进行编码,你必须确保找到所有这些被编码的部分,还要能够可靠地开启和关闭它们。目前的模型可以实现这一点,但非常脆弱……这是其中一个圣杯问题。”

Adebayo 在 MIT 攻读博士学位期间开始了这项工作,并合著了一篇2020年广泛引用的研究论文,该研究指出现有方法不足以解释深度学习模型的行为。其成果是开发出一种新的构建大型语言模型的方法:开发者在模型中插入一个概念层,将数据分类为可追踪的类别。

这种方法的一个担忧是可能会消除一些新兴行为,这些行为让大型语言模型如此引人注目——它们能够在未受训练的情况下以新颖的方式进行泛化。Adebayo 表示他的团队仍在追踪模型自行发现的概念,例如量子计算等。“这种可解释性实际上是从底层工程模型开始的,而不需要进行神经科学分析。”

对于面向消费者的应用场景,这些技术可以让开发者实现屏蔽版权内容、或更好地控制涉及暴力和毒品滥用等内容输出等功能。在金融等行业中,监管要求更严格的可控模型,例如评估贷款申请者的模型需要考虑财务记录但不应考虑种族等因素。

此外,在科学工作中也需要这种可解释性。Guide Labs 已开发相关技术,以帮助科学家更好地理解他们的软件如何得出成功的组合。“训练可解释的模型已不再是科学问题;它现在是一个工程问题。”Adebayo 表示,“我们已经确定了这些科学原理,并可以进行大规模应用,这使得这种模型不会逊色于前沿水平的大型语言模型。”

Guide Labs 称 Steerling-8B 可以达到现有模型90%的功能,但训练数据需求更少,得益于其创新架构。该公司计划进一步开发更大规模的模型,并提供 API 和代理访问服务。

Adebayo 进一步表示:“当前我们培训模型的方式非常原始,因此普及固有可解释性实际上是一项长期对人类有益的事情。”“在追求更智能的模型时,你不希望有任何对你而言神秘的事物做出决定。”

推荐意见