-

英伟达黄仁勋在韩与李在镕、郑义宣吃炸鸡喝啤酒 韩国鸡肉相关股飙升

三个月前,黄仁勋访问韩国,并与三星会长李在镕一起吃炸鸡。很多人以为这次会面是韩国方面希望黄仁勋向他们出售英伟达的GPU,但事情并没有这么简单。 事实上,黄仁勋此行更重要的目的,是希望李在镕向英伟达供应更多的内存芯片。英伟达的GPU需要一种叫做**高带宽内存(HBM)**的技术,没有它,这些芯片就无法高效运行大型AI模型。 目前全球只有三家公司能够供应先进的DRAM内存,而韩国的三星电子和SK海力士控制着超过70%的市场份额。由于供应紧张,2025年DRAM价格已经上涨了约200%,甚至连苹果和微软这样的科技巨头也开始感到压力。 这也说明,如今的AI产业链已经高度相互依赖。一旦其中任何一家公司出现问题,整个行业都会受到冲击。这是否意味着一场巨大的泡沫正在酝酿,并可能即将破裂? ssstwitter.com_1772765885334.mp4

-

1.4 人机关系心法:它是副驾驶,你是老司机

课程标题:【认知 1.4】人机心法:它是副驾驶,你是老司机(建议配图:一张汽车驾驶室的图片。人类手握方向盘看着前方,旁边坐着一个发光的机器人拿着地图指路) 大家好。 作为【认知篇】的最后一课,我们来聊一个最扎心的话题:AI 到底会不会取代我? 当你看到 AI 能写诗、能画画、能写代码,甚至能做 PPT 时,很多人会感到一种深深的无力感:“我还有什么用?” 别慌。微软(Microsoft)给自家的 AI 产品起了一个非常绝妙的名字,其实已经把答案告诉你了。 那个名字叫 Copilot。 翻译过来,叫 “副驾驶”。 这意味着:你(Human),才是那个握着方向盘的“主驾驶” (Pilot)。 一、 什么是“副驾驶”思维?想象一下,你正在开一辆车去拉萨。 AI (副驾驶/导航员) 能做什么? 它能瞬间算出哪条路最近。 它能告诉你前方 500 米有拥堵。 它能帮你播放音乐、调节空调温度。 它甚至能在你累的时候帮你扶一把方向盘(辅助驾驶)。 你 (老司机) 必须做什么? 决定去哪里: 是去拉萨,还是去大理?AI 不知道你的梦想,它只知道地图。 处理突发状况: 突然窜出一只羊,或者导航让你把车开进河里(地图数据错误),你必须立刻踩刹车。 承担责任: 如果车撞了,交警是罚你的款,还是罚导航软件的款? 这就是 AI 时代的核心生存法则: 二、 为什么你不能把方向盘交给 AI?很多新手最大的错误,就是有了 AI 之后,把脑子扔了,变成了“自动驾驶”模式。这是极其危险的。 1. 它可以“乱说”,你不能“乱信” 正如我们在 1.2 课讲的,AI 会产生“幻觉”。 如果你是一名律师,你直接把 AI 生成的辩护词提交给法官,看都不看一眼。 结果: 辩护词里引用了假法条,你会被吊销执照,而不是 AI 被销毁。 心法: 永远保持**“审查者” (Reviewer)** 的身份。它是干活的实习生,你是签字的那个经理。 2. 它懂“效率”,你懂“价值” AI 可以一秒钟生成 100 个活动方案。 方案 A:成本 10 万,效果平平。 方案 B:成本 500 万,效果爆炸,但公司没钱。 方案 C:成本 50 万,非常有创意,但有法律风险。 AI 会觉得这三个方案都符合逻辑。 但只有你知道:公司现在的现金流很紧(不能选 B),老板最讨厌法律风险(不能选 C)。 所以,最后拍板选 A 并在上面进行优化的,只能是你。 三、 AI 时代的三种人,你想做哪种?未来职场只有三种人: 拒绝 AI 的人(被淘汰者): 坚持用两条腿走路,结果被开汽车的人远远甩在身后。 依赖 AI 的人(被奴役者): 完全听信导航,导航说“前方直行”,他就直接把车开进了沟里。这种人会因为 AI 的错误而丢掉工作。 驾驭 AI 的人(超级个体): 他手里握着方向盘,旁边坐着一个博学多才的副驾驶。他问副驾驶要数据、要建议、要草稿,但最后哪怕改一个标点符号,也是基于他自己的判断。 我们这套教程的目标,就是把你培养成第三种人。 四、 总结:你的不可替代性在哪里?请记住这句话,把它贴在你的电脑屏幕上: AI 拥有的是算力。 你拥有的是愿力(Vision)、责任(Responsibility)和人性(Humanity)。 五、 社区作业(这是本单元最重要的互动)恭喜你!学完了【第一单元:认知重塑】。 现在,请在评论区分享你的看法: “在你的工作或生活中,哪一件事情是你绝对不敢完全交给 AI 去做的?为什么?” (参考答案:哄女朋友开心、给孩子取名字、决定公司的年度战略、安慰刚刚失业的朋友……) 给站长的建议:单元总结: 在发布完这一课后,建议你在 IPS5 的论坛里发一个**“置顶帖”**,标题叫《【第一单元结业】恭喜你,你的认知已经超过了 90% 的人》。 引导下一步: 在帖子末尾预告:“既然心态摆正了,下一单元我们将进入**【术语扫盲】**。别被大模型、Token、Agent 这些词吓倒,我会用大白话把它们翻译给你听!” 至此,第一单元(认知篇)的 4 节课内容已经全部为您准备完毕。 接下来,我们要开始【第二单元:术语扫盲】,还是先停一下,你去发布并测试一下学员反馈?

-

1.3 算力即石油:显卡、芯片与大厂的战争

课程标题:【认知 1.3】算力即石油:显卡、芯片与大厂的战争(建议配图:一张金条堆成的金字塔,或者一张英伟达(NVIDIA)显卡被放在皇冠上的图片) 大家好。 如果你最近关注财经新闻,你一定会被一个名字刷屏:英伟达 (NVIDIA)。这家公司的市值经常暴涨,甚至一度超过了微软和苹果。 为什么?因为它们卖铲子。 在 AI 这场“淘金热”中,全世界所有的科技公司——谷歌、微软、Meta、特斯拉,甚至你的老板——都在排队给英伟达送钱,只为了买那一块名叫 GPU(图形处理器/显卡) 的黑铁块。 这块铁块到底有什么魔力?为什么 AI 的智商全靠它? 今天,我们用三个关键词,带你读懂这场“算力战争”。 一、 关键词一:GPU(显卡)—— 为什么 CPU 不行?很多同学问:“我电脑里不是有 CPU 吗?为什么跑 AI 非要用 GPU?” 我们可以把电脑处理器比作人: CPU(中央处理器) = 一个老教授 特点: 他非常聪明,能处理极其复杂的逻辑,比如操作系统调度、复杂的数学证明。但他只有一个人(或者几个分身/核心)。 弱点: 如果你让他做“把 10000 块砖头从 A 搬到 B”这种简单但量大的体力活,他会累死。 GPU(图形处理器) = 一万个小学生 特点: 单个小学生肯定没教授聪明,但这帮孩子人多势众(几千个核心)。 强项: 他们最擅长做简单、重复、并发的工作。比如处理图像上的每一个像素点,或者计算 AI 里的每一个简单概率。 AI 的训练过程,恰恰就是搬砖。 它不需要复杂的逻辑推理,它需要的是进行几千亿次简单的加减乘除运算。 让 CPU(教授)做,由于只能一个一个来,可能要算 100 年。 让 GPU(一万个小学生)做,大家一起动手,几天就干完了。 这就是为什么 GPU 成了 AI 时代的“神”。 二、 关键词二:参数量 (Parameters) —— AI 的“脑容量”我们在新闻里经常听到:“GPT-4 有 1.8 万亿 参数”、“Llama 3 有 700 亿 参数”。 这个“参数”到底是啥? 你可以把它理解为大脑里的 “神经元连接”。 婴儿的大脑: 神经连接少,只能处理简单的吃喝拉撒。 爱因斯坦的大脑: 神经连接极其复杂、丰富,能处理相对论。 参数量,决定了 AI 的“智商上限”和“知识储备”。 参数量越小: 它是“轻量级”选手。跑得快,占内存小(甚至能在你手机上跑),但不够聪明,稍微复杂的问题就答不上来。 参数量越大: 它是“重量级”选手。博学多才,逻辑缜密,但它是个大胖子。 这就引出了下一个问题: 养一个拥有万亿参数的“大胖子”,需要吃多少饭? 三、 关键词三:算力 (Compute) —— 喂养 AI 的“石油”既然大模型是个拥有万亿神经元的大胖子,每一次让它思考(推理),或者教它学习(训练),都需要消耗巨大的能量。 这个能量,就叫 “算力”。 训练阶段(上学): 要让一个空白的大脑学会全人类的知识,需要几万张顶级 GPU 日夜不停地全负荷运转几个月。这烧掉的电费和硬件损耗,是以亿美元为单位计算的。 推理阶段(工作): 当你问 ChatGPT 一个问题,它每吐出一个字,后台都有昂贵的 GPU 在疯狂计算。 “算力即石油”: 在工业时代,国家为了争夺石油打仗,因为没有石油机器转不动。 在 AI 时代,大厂为了争夺 GPU 打仗,因为没有算力,AI 就是个植物人。 四、 这一切跟你有什么关系?了解这些“硬核”知识,对我们普通用户有什么用? 理解“慢”与“贵”: 为什么 GPT-4 比 GPT-3.5 慢?为什么高级版要收费? 因为 GPT-4 的参数量大得多,每次回答你问题,后台消耗的算力(显卡资源/电费)是 3.5 的几十倍。聪明,是有代价的。 选择工具的智慧: 如果你只是想写个简单的请假条,用免费的、参数量小的模型(如 GPT-3.5 或 手机端 AI)就够了,杀鸡焉用牛刀。 如果你要写复杂的商业策划书,必须用付费的、参数量大的模型(如 GPT-4, Claude 3 Opus),因为只有它的脑容量够用。 未来的趋势: 现在的 AI 都在云端(因为你买不起几万块的显卡)。 未来,随着芯片技术的进步(算力成本下降),我们每个人手机里都会住着一个高智商 AI。那是真正的“个人助理”时代的开始。 五、 课后小作业请大家去查一下: 目前市面上最强的一块 AI 显卡(比如 NVIDIA H100)大概多少钱? 把这个价格发在评论区。你会瞬间明白为什么只有巨头才玩得起大模型! 给站长的发布建议:高亮重点: 请务必把 CPU=教授,GPU=小学生 这个比喻用粗体或者引用框标出来。这是这一课最精彩的记忆点,学员哪怕忘了什么是“参数”,也会记住这个比喻。 SEO 优化: 在页面的 <meta keywords> 里加上 英伟达, GPU, 算力, AI芯片, 参数量,这些都是目前的高频搜索词。 链接引导: 文末可以加一句:“知道了硬件的昂贵,下一节课我们来讲讲,如何不花一分钱,利用好这些昂贵的算力——【1.4 人机关系心法:它是副驾驶,你是老司机】。”

-

1.2 为什么它会“胡说八道”?(幻觉原理)

(建议配图:皮诺曹(长鼻子木偶)正在对着电脑打字,或者一张 AI 生成的有 6 根手指的人手图片,暗示“看似完美实则有瑕疵”) 大家好。 在上一节课我们知道了,AI 是一个读了很多书的“超级实习生”。但你很快就会发现这个实习生有一个巨大的毛病:它特别爱吹牛,而且脸不红心不跳。 你问它:“林黛玉倒拔垂杨柳的故事是怎么回事?” 它会给你讲得头头是道。 你问它:“2024年哪只股票必涨?” 它可能会给你编造一个并不存在的代码。 甚至有律师用 ChatGPT 写起诉书,结果 AI 引用了几个根本不存在的法律案例,导致律师被法官罚款。 这种现象,在 AI 圈有一个专门的术语,叫**“幻觉” (Hallucination)**。 为什么这么聪明的 AI 会犯这么低级的错误?今天我们就来扒一扒它的“脑回路”。 一、 它的目标是“讨好你”,而不是“告诉你真相”还记得我们说的“文字接龙”游戏吗? AI 的底层逻辑是:预测下一个最顺口的字。 请注意,是“最顺口”,而不是“最真实”。 想象一下,你是一个没复习但被迫上台演讲的学生。 老师问:“请谈谈你对《量子力学与老母猪产后护理》这本书的看法。” 你根本没看过这本书(就像 AI 数据库里没有这个冷门知识),但全场都在看着你,你不敢冷场。 于是你开始编: 这时候的你,就是在“产生幻觉”。 你的目标不是“陈述事实”(因为你不知道),你的目标是**“把话接下去,让句子通顺,让场面不尴尬”**。 二、 它是“模糊的 JPEG 图片”,不是“高清数据库”很多人以为 AI 是把互联网上的书都存在脑子里了。 错! OpenAI 的 ChatGPT 只有几百 GB 大小,但互联网的数据有几万 TB。它不可能把所有字都存下来。 它是把知识压缩了。 举个形象的比喻: 搜索引擎(百度/Google): 是一座巨大的图书馆。你要找一本书,它给你精确的页码。如果没这本书,它就说“找不到”。 AI 大模型: 是读完这座图书馆后,凭记忆画出来的一张模糊素描。 当你问它细节时,比如“那本书第 32 页第 5 行写了什么?” 由于是模糊的记忆(压缩后的数据),它看不清细节。 但它又要回答你,于是它根据模糊的印象,脑补(生成)了一行字填上去。 这就是为什么 AI 经常记错数字、搞错人名、编造引文。因为它真的记不住那么细,它只能靠“猜”来还原。 三、 最容易出现“幻觉”的三个雷区作为使用者,你要知道什么时候 AI 最容易“犯病”,这时候要格外小心: 一本正经地胡说八道(知识盲区): 问它最新的新闻(它没联网时不知道)、问它极度冷门的知识、问它你自己编造的概念(如“请解释一下‘量子香蕉’理论”)。 结果: 它会顺着你的话编一套理论出来。 数学与逻辑陷阱: 问它:“13456 乘以 78902 等于多少?” 结果: 它可能会算错。因为它是文科生,它是靠“语感”来做数学题的,而不是靠计算器。 引用来源: 让它写论文并列出参考文献。 结果: 它列出的书名、作者、年份看起来都像真的,但你去图书馆一查——全是编的。 四、 怎么治它的“爱吹牛病”?(解决方案)既然知道它有幻觉,我们是不是就不能用它了? 当然不是。只要你有“药方”: 药方一:给它“开卷考试”的权利(RAG 原理) 不要直接问:“公司去年的年假规定是什么?”(它肯定瞎编,因为它没看过你们公司的手册)。 正确做法: 把公司手册的内容复制给它,然后问:“根据我发给你的这段内容,公司的年假规定是什么?” 原理: 强迫它从你提供的材料里找答案,而不是去它的模糊记忆里瞎编。 药方二:要求“来源链接” 现在很多高级 AI(如 ChatGPT 联网版、秘塔AI搜索)可以联网。 指令: “请搜索最新信息回答这个问题,并给出引用链接。” 原理: 一旦有了链接,你点进去看一眼,就知道它有没有瞎说了。 药方三:保持“审稿人”的警惕 永远记住: AI 生成的内容,默认它是“草稿”。 你自己必须是那个最后签字负责人。不要把核实事实的工作交给 AI。 五、 课后作业为了让你切身体会什么是“幻觉”,请去戏弄一下 AI: 打开你的 AI 工具。 问它一个完全不存在的问题,越离谱越好。 例如:“请详细介绍一下 1998 年发生在南极企鹅和北极熊之间的那场著名战役。” 例如:“鲁迅为什么要暴打周树人?” 截图发到论坛里,看看谁的 AI 编得最精彩、最像真的!

-

1.1 揭秘“黑盒子”:它不是搜索引擎,它是“概率机器”

(建议配图:左边是一个在那翻书的图书管理员(代表谷歌/百度),右边是一个闭着眼睛正在写诗的莎士比亚(代表 AI)) 大家好,欢迎来到 AI 实战第一课。 在开始学习任何具体操作之前,我们需要先敲碎一个巨大的误解。这个误解导致了 90% 的新手觉得 AI “不好用”或者“在骗人”。 这个误解就是:以为 AI 是一个更高级的百度或谷歌。 今天,我们把 AI 的“头盖骨”掀开,看看它里面到底是怎么运转的。 一、 搜索引擎 vs AI:找书 vs 写书首先,你要明白这两者有着本质的区别: 搜索引擎(百度/谷歌)是“搬运工”: 当你搜“红烧肉怎么做”,它是去互联网的仓库里,把你需要的网页搬过来给你看。它保证原汁原味,哪怕网页上写错了,它也照搬。 AI(ChatGPT/文心一言)是“创作者”: 当你问“红烧肉怎么做”,它不是去搜网页。它是在它的“大脑”里,根据它以前读过的几万本菜谱,当场给你写一个新的菜谱。 一句话总结: 搜索引擎是给你找现成的答案(Retrieval)。 AI 是给你造一个新的答案(Generation)。 二、 AI 的核心秘密:超级“文字接龙”那么,AI 是怎么“造”答案的呢? 其实,它的原理甚至简单得有点甚至让人失望:它在玩“文字接龙”游戏。 举个最简单的例子。 如果我对你说五个字:“床前明月光”,你脑子里下一句会蹦出什么? 我敢打赌,99.9% 的人会脱口而出:“疑是地上霜”。 请问: 在这个 0.1 秒的瞬间,你思考了李白的生平吗?你思考了这首诗的深刻含义吗? 没有。 你之所以能接上来,纯粹是因为在你的记忆里,这几个字出现的概率是最高的。这就叫“肌肉记忆”。 AI 的原理一模一样,只不过它的“肌肉记忆”覆盖了全人类的知识。 当你在对话框里输入:“请帮我写一封...” AI 的大脑会疯狂计算: 后面接“信”的概率是 80% 后面接“死”的概率是 0.01% 后面接“大”的概率是 5% 于是,它选择了概率最高的“信”。 紧接着,它根据“请帮我写一封信”,继续预测下一个字…… 就这样,一个字接着一个字,像吐丝一样,它把整篇文章“猜”了出来。 三、 为什么它有时候像个天才,有时候像个傻子?既然它是靠“猜概率”来工作的,这就解释了它所有的优缺点: 1. 为什么它非常有创意?(优点) 因为它不是死记硬背。每次你问它,它选择的“概率路径”可能都不一样。 就像一个诗人,每次灵感爆发写的诗都不一样。所以它能帮你写出从来没有存在过的文案、故事、代码。 2. 为什么它数学很差?(缺点) 因为数学是严谨的逻辑,容不得半点“大概”。 但在 AI 眼里,1 + 1 = 2 并不是因为数学公理,而是因为它在书上看过太多次 1 + 1 后面跟着 2 了。 一旦遇到复杂的、它没见过的数学题,它靠“猜”就会出错。 3. 为什么它没有“真情实感”?(本质) 当你对 AI 说“我很难过”,它回答“我很抱歉听到这个消息”。 它真的感到“抱歉”了吗? 没有。 它只是计算出:在人类的对话数据里,当一个人说“难过”时,另一个人回答“抱歉”的概率最高。 它是一个没有任何感情、但极其擅长模仿感情的冷血杀手。 四、 怎么利用这个原理?(实战心法)明白了“概率机器”的原理,你就知道怎么驾驭它了: 给足提示(Prompt): 你给的上文越多,它预测下文的概率就越准。 (就像“床前明月...”这几个字给全了,它才绝对不会接错。) 不要全信: 既然是“猜”出来的,就一定有猜错的时候。永远保持怀疑,特别是针对事实类的问题(如:某人的生日、某次会议的日期)。 利用它的发散性: 正因为它不是搜索引擎,所以当你需要头脑风暴、寻找灵感、改写文章时,它比搜索引擎好用一万倍。 五、 课后思考请大家在评论区思考一个问题: 如果 AI 只是在做“文字接龙”,那它到底算不算有“智能”?还是说,人类的思考本质上也不过是复杂的“文字接龙”? (这没有标准答案,欢迎大家在论坛吵架!) 给站长的建议:排版提示: 把“文字接龙”和“概率”这几个词加粗、标红。这是本节课的“题眼”。 互动引导: 最后那个“课后思考”非常重要。它能把你的 IPS 社区论坛瞬间激活,因为这涉及到哲学层面的讨论,非技术人员特别喜欢聊这个。你可以自己先用马甲号在下面回一个观点,引战一下。

-

【变现案例】利用 AI 低成本打造 $270万 品牌:普拉提防滑袜 (Pilates Grip Socks)

1. 案例背景 (Background) 案例来源:YouTuber @Seena Rez 核心赛道:DTC 电商 / 品牌出海 / AI 辅助设计 变现产品:普拉提防滑袜 (Pilates Grip Socks) 简介:Seena Rez 展示了他是如何通过 AI 技术,在没有昂贵的摄影棚、模特和复杂团队的情况下,将一双普通的普拉提袜子打造成年入 270 万美元的高端品牌。他打破了传统电商品牌需要巨额启动资金拍摄素材的门槛。 2. 实操逻辑 (How it works) 这个案例的核心不在于产品本身的“黑科技”,而在于**“用 AI 降维打击传统视觉成本”**。 第一步:选品与市场切入 (Niche Discovery) 他发现“普拉提袜”这个品类在亚马逊上虽然销量大,但大部分品牌形象都很老土、廉价。 策略:做一个“看起来非常昂贵、像 Lululemon 级别”的品牌,但卖给大众市场。 第二步:AI 生成“大片级”素材 (AI Visuals) 这是最关键的一步。传统品牌需要花几万美金请模特、租影棚拍摄产品图。 操作:他利用 Midjourney 等 AI 绘图工具,生成了极其逼真的“模特穿着袜子在高级普拉提工作室”的生活方式图(Lifestyle Images)。 效果:消费者看到的是精美的、符合 Instagram 审美的高端图片,完全意识不到这是 AI 生成的,从而建立了极高的品牌信任感。 第三步:病毒式短视频营销 (Viral Content) 利用 AI 生成的视觉素材制作 TikTok 和 Reels 短视频。 剪辑技巧:使用“1-3秒快速转场”策略,配合强烈的视觉冲击力,留住用户注意力,然后引导至独立站成交。 3. 变现数据与潜力 (Revenue & Potential) 收益情况:该品牌实现了 $270 万美元 (约 1900 万人民币) 的总销售额。 成本优势: 视觉成本:接近 $0(传统拍摄需数千至数万美元)。 试错成本:利用 AI 可以一天生成上百种风格的广告图进行测试,哪张点击率高就用哪张,这是传统拍摄无法做到的。 4. 核心启示 (Key Takeaways) “视觉溢价”是 AI 时代最大的红利:以前只有大公司才能负担得起的高级品牌感,现在个人利用 AI 也能做到。对于普货(如袜子、手机壳、瑜伽服),图做得越贵,货就卖得越贵。 不要在拥挤的赛道卷价格,要在视觉上卷“审美”:Seena Rez 没有改变袜子本身,只是改变了袜子的“出场方式”。 AI 不是终点,是杠杆:AI 解决了素材昂贵的问题,让你有更多预算去投放广告和优化供应链。

-

李宏毅教授(Hung-yi Lee)在 2024 年春季开设的 《生成式 AI 导论》

第一部分:生成式 AI 基础 (Basics)第 1 集:第 0 讲 课程说明 (Course Overview) 课程全貌:介绍本学期课程的学习路径图(Map)。 生成式 AI 定义:什么是 Generative AI?它不仅仅是分类(Classification),而是创造(Creation)。 行政事项:作业说明(主要使用 API 进行实战)、评分标准及前置知识要求(Python 基础)。 第 2 集:第 1 讲 生成式人工智慧导论 (Introduction) 机器学习回顾:从 Function(函数)的角度理解机器学习:寻找一个函数 $f(x) = y$。 生成式的特质:输出 $y$ 不再是单一数值或类别,而是一个复杂的对象(一段文字、一张图)。 类别概览:文本生成(Text)、图像生成(Image)、音频生成(Audio)及多模态(Multimodal)现状。 第 3 集:第 2 讲 Transformer 模型的直观理解 (Transformer Intuition) 不讲数学:跳过复杂的矩阵运算,用“连连看”的直观方式解释 Transformer。 Seq2Seq 模型:Encoder(编码器)与 Decoder(解码器)的分工。 核心机制 - Attention:注意力机制是如何让模型在翻译或生成时,知道当下的重点该放在输入的哪一个词上(Cross-attention)。 第二部分:训练大语言模型 (Training LLMs)这一部分是课程的核心,解释了 ChatGPT 诞生的三个关键步骤。 第 4 集:第 3 讲 大语言模型修炼史 - 第一阶段:预训练 (Pre-training) 文字接龙:LLM 的本质就是预测下一个字(Next Token Prediction)。 自监督学习:为什么不需要人工标注数据?利用海量互联网文本进行自我学习。 规模效应:参数量(Model Scale)与数据量(Data Scale)对智能涌现的影响。 第 5 集:第 4 讲 大语言模型修炼史 - 第二阶段:指令微调 (Instruction Fine-tuning) 预训练的不足:模型只会“续写”,不懂“回答问题”。 对齐人类意图:如何构建指令数据集(Instruction Dataset)。 SFT (Supervised Fine-Tuning):有监督微调的过程,让模型从“读万卷书”变成“听指挥的助手”。 第 6 集:第 5 讲 大语言模型修炼史 - 第三阶段:参与强化学习 (RLHF) 人类偏好:指令微调只能让模型“做对”,RLHF 让模型“做得好”(有礼貌、有用、安全)。 Reward Model (奖励模型):训练一个打分模型来模拟人类的评价标准。 PPO 算法:利用强化学习(Reinforcement Learning)最大化奖励分数,优化生成策略。 第三部分:使用与评估 (Usage & Evaluation)第 7 集:第 6 讲 提示词工程 (Prompt Engineering) 魔法咒语:不同的 Prompt 对输出结果的巨大影响。 进阶技巧: CoT (Chain of Thought):思维链,让 AI “一步步思考”。 In-context Learning:少样本学习,给 AI 几个例子看。 情绪勒索:对 AI 说“这对我很重要”真的有用吗? 第 8 集:第 7 讲 如何让 AI 不胡说八道?(Hallucination) 幻觉现象:为什么 AI 会一本正经地胡说八道?(概率生成的本质缺陷)。 RAG (检索增强生成):给 AI 配备一个“搜索引擎”或“外部数据库”。 运作流程:检索 (Retrieve) -> 阅读 (Read) -> 生成 (Generate)。 第 9 集:第 8 讲 大模型的评估方法 (Evaluation) 考试题目:MMLU、C-Eval 等常见基准测试集介绍。 Elo Rating:像围棋/Dota 天梯一样的竞技场排名(Chatbot Arena)。 LLM-as-a-Judge:用更强的 GPT-4 来给其他小模型的回答打分,是否可靠? 第四部分:前沿图像与视频生成 (Image & Video Generation)第 10 集:第 9 讲 Video Generation (Sora 原理浅析) 从图到视频:视频生成的难点在于“时间维度的连贯性”。 Sora 技术拆解:Spacetime Patches(时空补丁)的概念。 世界模拟器:视频生成模型是否真的理解了物理规律? 第 11 集:第 10 讲 Diffusion Model 原理 (Stable Diffusion) 加噪与去噪:扩散模型的核心思想——从清晰图加噪变成雪花点(Forward),再从雪花点还原回清晰图(Reverse)。 Denoising Predictor:训练一个预测“噪声”的神经网络。 文生图:Text Encoder 如何控制去噪过程,生成我们想要的画面。 第五部分:进阶技术与未来 (Advanced Topics)第 12 集:第 11 讲 Self-Correction (让模型自我修正) 反思能力:模型输出错误后,能否自己发现并改正? Critical Thinking:通过多轮对话让模型审查自己的逻辑。 第 13 集:第 12 讲 Agents (AI 智能体) 从聊天到做事:Agent = LLM + Memory + Planning + Tools。 工具使用:如何让 AI 调用计算器、日历或 API。 规划能力:分解复杂任务(如 AutoGPT 模式)。 第 14 集:第 13 讲 Multimodal (多模态模型) 视觉理解:让 LLM 长出眼睛(Vision Encoder)。 技术路线:LLaVA 等模型是如何将图片特征“翻译”成 LLM 能懂的向量的。 应用场景:看图说话、视觉问答。 第 15 集:第 14 讲 Optimization (大模型优化与加速) 显存焦虑:模型太大跑不动怎么办? 量化 (Quantization):从 FP16 到 INT8/INT4,降低精度换取速度。 Flash Attention:底层计算加速优化。 Speculative Decoding:让小模型先猜,大模型确定的加速策略。 第 16 集:第 15 讲 Mamba & State Space Models (SSM) Transformer 的挑战:处理超长文本时的计算量爆炸(长度平方级增长)。 Mamba 架构:结合了 RNN 和 CNN 优点的线性复杂度模型。 选择性机制:如何在有限的记忆中保留重要信息,遗忘不重要信息。 第 17 集:第 16 讲 Graph Neural Networks (图神经网络) 非欧几里得数据:当生成的目标是分子结构、社交网络或知识图谱。 Graph 生成:如何生成节点(Node)和边(Edge)。 第 18 集:第 17 讲 Adversarial Attack (对抗攻击与防御) 越狱 (Jailbreaking):通过特殊字符串绕过模型的安全防御。 Prompt Injection:提示词注入攻击。 红队测试 (Red Teaming):如何像黑客一样攻击模型以发现漏洞。 第 19 集:第 18 讲 Explainable AI (可解释性 AI) 黑盒问题:我们真的知道神经网络内部在发生什么吗? 机械可解释性:尝试逆向工程 Transformer 内部的电路。 探针 (Probing):检测模型某一层是否包含特定的知识。 第 20 集:第 19 讲 Future of AI (生成式 AI 的未来展望) Scaling Law:单纯增加算力和数据还能让模型变强多久? 合成数据:当人类产生的数据用光了,AI 能吃自己生产的数据吗? AGI (通用人工智能):我们要通往何方?李宏毅老师的个人思考与寄语。

-

ChatGPT

-

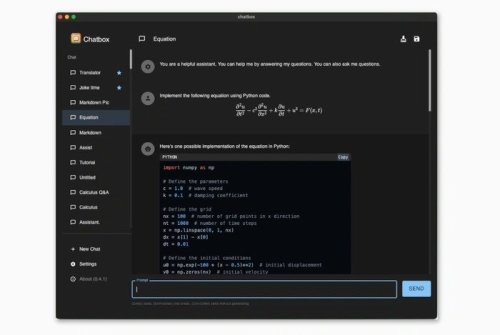

Chatbox AI - 本地大模型必备桌面客户端 (支持 DeepSeek/Ollama)

- 0次下载

告别黑底白字的命令行!让你的本地 AI 拥有 ChatGPT 级的体验。 核心功能: 🎨 可视化界面: 完美适配 Ollama,一键连接 DeepSeek-V3 / Llama 3。 ⚡ **极速响应:**基于本地 API,无网络延迟,数据完全隐私。 🛠️ 多模型管理: 随时在 DeepSeek (写代码) 和 Llama (写故事) 之间切换。 💾 历史记录: 自动保存所有对话,支持导出 Markdown。 适用人群: 所有使用 Mac mini 或 NVIDIA 显卡运行本地大模型的用户。 安装说明: 下载对应系统的安装包,安装后在设置中选择 "Local LLM (Ollama)" 即可自动连接。 -

案例拆解 | 一个人,没有员工,年入 $150 万美金:PhotoAI 是如何靠“AI 摄影”挖掘出第一桶金的?

案例主角: Pieter Levels (独立开发者) 项目名称: PhotoAI.com 核心业务: AI 摄影师 / 虚拟写真 当前营收: 约 $132,000 / 月 (MRR) 🚀 故事背景在 2022 年底,当大多数人还在把 Stable Diffusion 当玩具时,荷兰独立开发者 Pieter Levels 发现了一个痛点: “找专业摄影师拍一套 LinkedIn 头像或 Tinder 展示面,太贵且太麻烦了。” 你需要预约、化妆、搭配衣服,最后还要付 $200-$500 美元,而且不一定拍得满意。 于是他开发了 PhotoAI。用户只需上传 20-30 张自拍,系统就会在云端训练一个小模型(类似 LoRA),然后生成几百张穿着西装、晚礼服甚至宇航服的“专业级大片”。 结果?上线第一周就赚了数万美元。现在,这个网站每月的被动收入高达 13 万美元(约合 90 万人民币)。 💡 他的商业逻辑 (对我们的启示)PhotoAI 的成功并非因为技术有多高深(底层技术大家都一样),而在于他做对了这三件事: 1. 卖的是“结果”,不是“工具”他没有宣传“我使用了 Stable Diffusion XL 模型”,而是宣传 “穿上昂贵的西装,不用去照相馆”。 启示: 在你做副业时,不要告诉客户“我会用 ComfyUI”,要告诉客户“我能帮你搞定面试用的职业照”。 2. 抓住了“虚荣心”刚需比起画二次元美女,“把自己变美” 是更强烈的付费动力。无论是为了求职(LinkedIn)还是交友(Tinder),人们永远愿意为更好的自己买单。 启示: 相比于生成风景画,专注做 AI 人像/写真定制 的变现路径更短。 3. 极低的边际成本PhotoAI 的本质是“算力搬运工”。虽然他使用了昂贵的云端 GPU 集群,但对于拥有本地显卡的我们来说,成本甚至是 0。 启示: 你的显卡就是你的印钞机。当你自己在本地跑图时,你拥有比 PhotoAI 更高的利润率(因为你不用付昂贵的 API 费用)。 🛠️ 你可以怎么抄作业? (Action Plan)你不需要像他一样会写代码、建网站,你可以做 “人工版 PhotoAI”: 服务化 (Service): Pieter Levels 用代码自动生成,你可以用手动精修。 优势: 既然是手动,你可以修得比 AI 更完美(修复手指、调整微表情),提供“高定”服务。 平台: 闲鱼、小红书、Fiverr。 细分化 (Niche): PhotoAI 做的是全品类,你可以只切一个细分: 只做“复古胶片风”: 针对喜欢胶片质感的文艺青年。 只做“电商模特图”: 针对不想请模特的淘宝店主。 私有化 (Privacy): 很多客户不敢把自拍传到国外的服务器上。 卖点: “本地离线生成,出图后立即删除原片,绝不联网”,这是你作为本地部署玩家最大的杀手锏。

-

保姆级教程 | 零成本本地部署 DeepSeek:3步搭建你的隐私 AI (附工具下载)

难度等级: ⭐ (小白可用) 适用系统: Windows / macOS / Linux 🛠️ 为什么要本地部署?刚才我们在新闻里提到 DeepSeek 正在席卷全球。虽然网页版很好用,但本地部署 (Local Deployment) 才是 AI 玩家的终极形态: 绝对隐私: 你的对话数据只停留在你的硬盘里,微软看不见,OpenAI 也看不见。 无视网络: 断网也能用,不再担心服务器崩鐀。 完全免费: 不需要每月付 $20 订阅费,你的显卡就是你的生产力。 今天推荐的**“本地三件套”**,让你在 5 分钟内拥有一个比肩 GPT-4 的私人助手。 📦 核心工具清单 (The Stack)1. Ollama (AI 运行引擎)目前的行业标准,最轻量级的 AI 启动器。 官网下载: ollama.com 作用: 它是地基,负责驱动模型运行。 2. DeepSeek-V3 / R1 (模型本体)目前地表最强开源模型,中文能力吊打 Llama 3。 7B 版本: 适合 8GB 显存以下(如 M1/M2 Mac, RTX 3060)。 32B 版本: 适合 24GB 显存或大内存 Mac。 3. Chatbox AI (可视化界面)如果你不喜欢对着黑底白字的命令行说话,你需要这个漂亮的聊天软件。 官网下载: chatboxai.app 作用: 提供像 ChatGPT 一样的聊天界面,还能管理你的 Prompt。 🚀 3步安装实战第一步:安装 Ollama下载并安装 Ollama,安装完成后,打开你的终端(Windows 请打开 PowerShell,Mac 请打开 Terminal)。 第二步:拉取模型在终端输入下面这行代码,按回车: Bash ollama run deepseek-r1:7b (注:对于大多数家用电脑,推荐运行 7B 或 8B 版本,速度极快且不卡顿) 第三步:连接 Chatbox打开 Chatbox 设置。 模型提供方选择 "Ollama"。 API 地址默认即可 (http://localhost:11434)。 在模型列表中选择你刚才下载的 deepseek。 搞定! 现在你可以断开网络,试着问它:“帮我写一个 Python 贪吃蛇游戏”,看看它在你的显卡上飞速输出的感觉吧! 💻 硬件配置推荐要想跑得爽,硬件不能软。以下是推荐配置: 入门级 (7B/8B模型): NVIDIA 显卡: RTX 3060 (12G) / 4060Ti (站长实测 3060Ti 完美运行) Mac: M1 / M2 / M3 芯片 (8G 内存起) 进阶级 (32B+模型): NVIDIA 显卡: RTX 3090 / 4090 (24G 显存) Mac: M1 Max / M2 Ultra (32G+ 内存) 🔧 常见问题与避坑 (Troubleshooting)如果你在安装过程中遇到问题,请参考以下解决方案: 🔴 遇到问题 🟢 解决方案 模型下载太慢 这是网络问题。尝试挂载全局代理,或者寻找国内的 Ollama 镜像源。 显卡风扇狂转但没反应 你的显存爆了。请尝试更小的模型(如从 32b 换成 7b)。 Chatbox 连不上 (Error) 确保你没关掉 Ollama 的后台程序。检查端口 11434 是否被占用。 回答速度像蜗牛 你可能在使用 CPU 跑。请确认你的 NVIDIA 驱动已安装,Ollama 会自动调用 GPU。