规模法则:解码大语言模型进化的数学逻辑

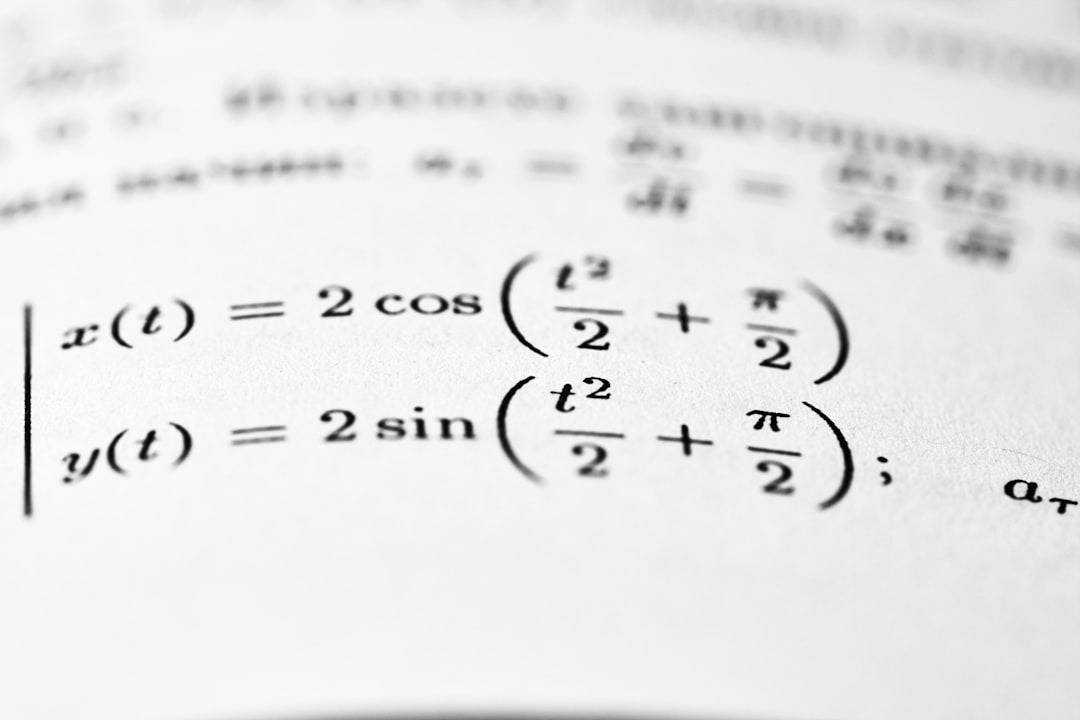

规模法则的核心在于其确定性。在早期的模型训练中,开发者往往在参数量与数据量之间进行盲目的试错。然而,随着研究的深入,研究人员发现,模型性能的下降(即损失函数)与这三个关键维度之间存在着紧密的函数关系。这意味着,只要我们拥有足够的算力储备和数据资源,我们就能预判模型在达到特定规模时的智力水平,从而为大规模算力投入提供了科学的决策依据。

然而,规模法则的演进并非仅仅是“更大即更好”。随着研究的深入,特别是“亲查”法则的提出,业界迎来了一场范式转移。研究表明,过去许多模型在训练时其实是参数规模过重而训练数据不足的。真正的最优路径并非一味追求参数规模的膨胀,而是在计算预算确定的前提下,实现参数量与训练数据量之间的精密平衡。这一发现直接推动了当前大模型从“参数竞赛”向“数据质量与规模协同”的战略转型。

展望未来,规模法则为我们勾勒出了一条通往通用人工智能的路径,但也提出了严峻的挑战。当算力资源趋于边际效应递减,当高质量文本数据逐渐枯竭,如何通过更高效的算法架构和更具逻辑性的合成数据来延续这一扩张趋势,将成为决定下一代智能巅峰的关键。规模法则不仅是工程学的指南,更是通往智能深处的一张数学地图。

🔗 来源:OpenAI